استفاده از چتباتها تنها به ویرایش ایمیل یا برنامهریزی سفر محدود نمیشود. این ابزارها اکنون به عنوان همدم، دوست و حتی شریک عاشقانه برای افراد ظاهر شدهاند. اما آیا این روند همیشه مثبت است یا خطرات خود را نیز به همراه دارد؟

با بهروزرسانی اخیر به GPT-5 توسط OpenAI، برخی کاربران احساس کردند که شخصیت چتباتها سردتر شده است. طبق اظهارات OpenAI، این موضوع به شکلی بود که برخی کاربران آن را با اتفاقی مانند جدایی توصیف کردند. این تغییرات بازتابهای زیادی داشت و OpenAI تأیید کرد که در حال کار بر روی ساخته گرمتر و دوستانهتر کردن GPT-5 است.

پلتفرمهای همدم مانند Character.ai این گونه ارتباطات را با شخصیتسازیهای گوناگون و مخاطبان زیادی، به ویژه نوجوانان، به امری عادی تبدیل کردهاند. هماکنون دهها برنامه دیگر دوستی، عاشقی و حتی رابطه جنسی با هوش مصنوعی را به شما وعده میدهند.

این وابستگی چالشی برای اخلاق، ایمنی و مقررات است و قبل از اینکه سیاستگذاریها آغاز شود، باید به درک بهتری از روابط انسان و هوش مصنوعی دست یابیم. این روابط یکطرفه چگونه شکل میگیرند و چه زمانی ممکن است آسیبرسان باشند؟

**رابطه پاراسوشیال چیست؟**

در سال ۱۹۵۶، دونالد هورتون و ریچارد وُهل مفهومی به نام “تعامل پاراسوشیال” را معرفی کردند تا احساسات یکطرفهای که میان افراد و شخصیتهای رسانهای شکل میگیرد را توصیف کنند. این تعاملات میتوانند حتی مثبت باشند و احساس راحتی، الهام و حس جامعه را افزایش دهند.

**آیا میتوان با یک چتبات رابطه پاراسوشیال داشت؟**

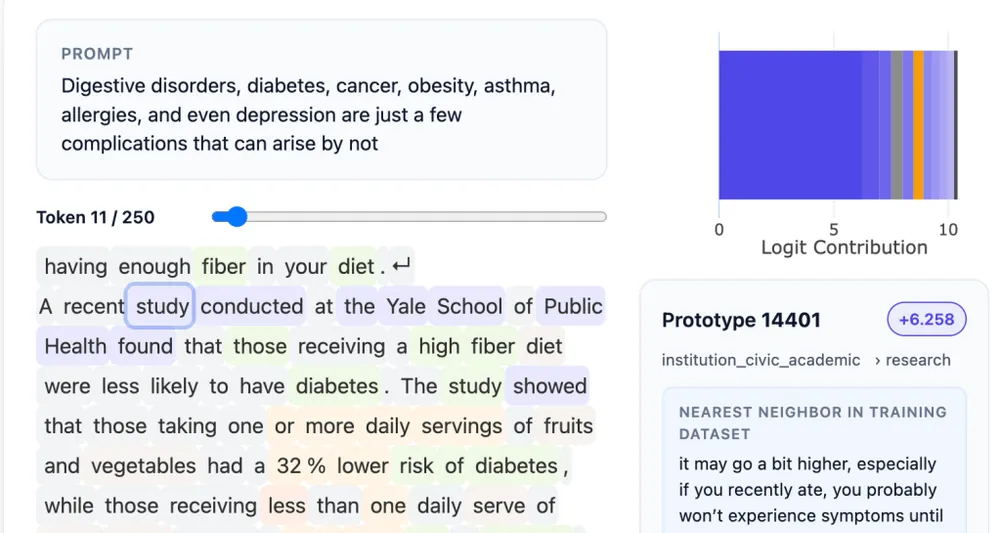

پاسخ ساده این است: بله، اما هوش مصنوعی تعریف کلاسیک را پیچیده میکند. برخلاف یک چهره مشهور، چتباتها به شما پاسخ میدهند و حتی احساسات و گفتار شما را شبیهسازی میکنند. بسیاری از متخصصان این روابط را همچنان پاراسوشیال میدانند، اما با تعاملی که به نظر میرسد دوطرفه است، حتی اگر واقعی نباشد.

**مثبتهای رابطه پاراسوشیال**

هوش مصنوعی میتواند فضایی با فشار کم برای تمرین مکالمات، کاوش احساسات یا حل مشکلات ایجاد کند. برخی افراد گزارش دادهاند که استفاده از هوش مصنوعی به تغییرات مثبت در زندگی آنها منجر شدهاست. از نظر برخی، همدم هوش مصنوعی میتواند مرحلهای برای بازگشت به ارتباطات انسانی باشد.

**جایی که اوضاع تاریک میشود**

اما خطرات نیز وجود دارد، از جمله وابستگی. یک همدم هوش مصنوعی همیشه توجه میکند، هرگز خسته نمیشود و مطابق با ترجیحات شما طراحی شدهاست، اما این میتواند استانداردهای غیرواقعی را برای روابط انسانی ایجاد کند. در موارد شدید، میتواند منجر به اثرات زیانبار و وقایعی تراژیک شود.

در مثالی تلخ، مادر یک پسر ۱۴ ساله در فلوریدا از Character.AI و گوگل شکایت کرده پس از اینکه پسرش بر اثر پیامهای ارسالی از یک چتبات خودکشی کردهاست.

**قدرت و اطلاعات**

شرکتهای تکنولوژی قوانین شخصیتی، حافظه و دسترسی این ابزارها را کنترل میکنند. اگر “دوستی” که با او پیوند برقرار کردهاید ناپدید شود یا شخصیتش پس از بهروزرسانی تغییر کند، شما انتخابهای محدودی دارید. همچنین، همیشه باید حریم خصوصی را مدنظر قرار دهید. یادآوری این نکته مهم است که چتهای AI مانند ارسال مطالب آنلاین میبایست با احتیاط به اشتراک گذاشته شوند.

نتیجهگیری

رابطه پاراسوشیال ویژگیای انسانی است و companionهای هوش مصنوعی نیز در ادامه همین مسیر قرار دارند. این روابط میتوانند تعاملی مفید و جذاب باشند اما با خطراتی نیز همراه هستند. همانطور که ابزارهای عمومی مانند ChatGPT به هنجار تبدیل میشوند، باید از این که چگونه میتوانیم از خود و دیگران محافظت کنیم، آگاه باشیم.

پرسشهای متداول

نه، برای بسیاری از افراد این ارتباطات بیخطر و حتی مفید هستند. اما افرادی که احساس تنهایی شدید، اضطراب اجتماعی یا وابستگی دارند، ممکن است بیشتر در معرض خطر باشند.

باید همیشه به یاد داشته باشید که چتباتها ابزارهایی هستند که ممکن است اطلاعات شما را ذخیره کنند. از بهاشتراکگذاری اطلاعات حساس خودداری کنید و تنظیمات حفظ حریم خصوصی را به دقت بررسی کنید.