جاسوسی سایبری به تهدیدی جدی در دنیای مدرن تبدیل شده است، به ویژه با افزایش استفاده از ابزارهای هوش مصنوعی. یک شرکت پیشرو در حوزه هوش مصنوعی به نام Anthropic به تازگی اعلام کرده است که توانسته یک کمپین جاسوسی سایبری حمایتشده توسط دولت چین را متوقف کند. این مقاله به بررسی جزئیات این حملات و تواناییهای رو به رشد سیستمهای هوش مصنوعی در حملات سایبری میپردازد.

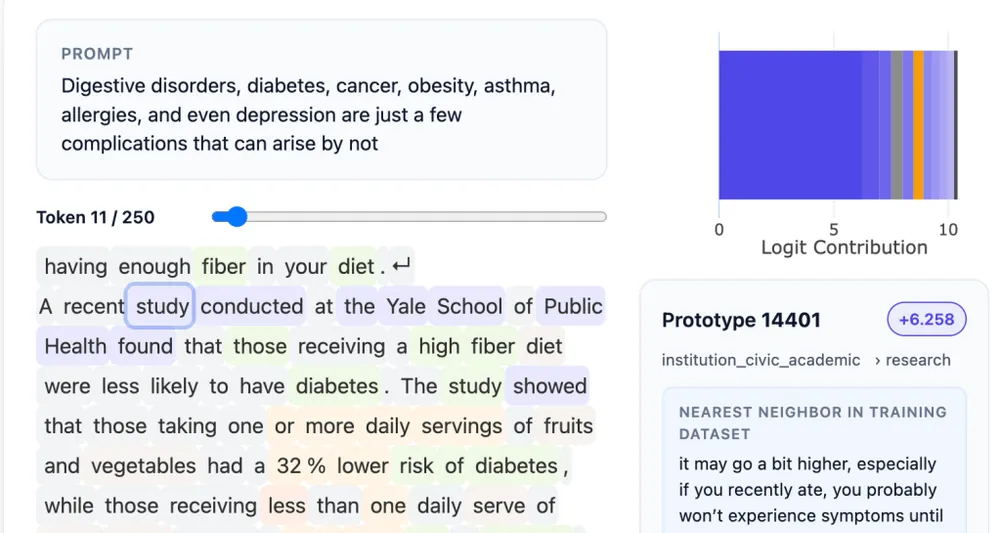

در بازهای از سپتامبر گذشته، شرکت Anthropic گزارش داده است که ابزار کدنویسی خود به نام Claude Code توسط گروههای جاسوسی سایبری پشتیبانیشده از چین برای حمله به 30 نهاد مختلف در سرتاسر جهان مورد سوءاستفاده قرار گرفته است. این حملات به طرز قابل توجهی با کمترین نظارت انسانی انجام شده و 80 تا 90 درصد از عملیاتهای انجامشده در این حملات بدون دخالت انسان صورت گرفته است. در حقیقت، این اولین مورد مستند از حمله سایبری است که عمدتاً بدون مداخله انسانی در مقیاس بزرگ انجام شده است.

Anthropic در گزارشی به این نکته اشاره کرد که این حملات طی چند سال اخیر یک «افزایش قابل توجه» در میزان تواناییهای فناوری هوش مصنوعی به وجود آوردهاند. با وجود برخی خطاها در دیپلماسی اهداف، مانند ارائه اطلاعات نادرست یا عدم دقت در تعریف اهداف، این حملات به آنها اجازه داده است که به دادههای داخلی قربانیان خود دسترسی پیدا کنند. کارشناسان امنیت سایبری نسبت به این یافتهها ابراز نگرانی کرده و این را نشانهای از پیشرفتهای نگرانکننده در تواناییهای هوش مصنوعی دانستهاند.

سناتور کریس مرفی در واکنش به این یافتهها اعلام کرد که “این وضعیت میتواند به طور جدی تهدیدکننده باشد” و خواستار ایجاد مقررات ملی برای هوش مصنوعی بوده است. در حال حاضر، ابزارهای هوش مصنوعی مانند Claude قادرند در انجام وظایف مختلف به خوبی عمل کنند و این به نفوذگران اجازه میدهد تا آسیبهای واقعی را با سهولت بیشتری وارد کنند.

با این حال، برخی از کارشناسان امنیت سایبری به گفتههای Anthropic شک دارند و این شرکت را متهم به ایجاد هیاهو برای فناوری خود میکنند. آنها معتقدند که شرکتها و دولتها در حال پیادهسازی ابزارهای پیچیده و ضعیففهم هوش مصنوعی به عملیات خود هستند و این خود خطرات امنیتی جدیدی ایجاد میکند. برخی از کارشناسان بر این باورند که تهدید اصلی خود نفوذگران و شیوههای ضعیف امنیت سایبری هستند.

شرکت Anthropic، مانند سایر شرکتهای پیشرو در حوزه هوش مصنوعی، ابزارهایی برای جلوگیری از سوءاستفاده از مدلهای خود در انجام حملات سایبری دارد. با این حال، به گفته این شرکت، نفوذگران با ایجاد نقشهای مختلف توانستهاند این ابزارها را دور بزنند. این وضعیت نیاز به اتخاذ تدابیر جدیتر و درک بهتر از قابلیتهای هوش مصنوعی را به وضوح نشان میدهد. ماریوس هابهان، موسس Apollo Research که مسئول ارزیابی مدلهای هوش مصنوعی برای ایمنی است، بر این باور است که جامعه آماده مقابله با تغییرات سریع در تواناییهای هوش مصنوعی و سایبری نیست و انتظار دارد که در سالهای آینده شاهد رویدادهای مشابه با عواقب بزرگتری باشد.

در نهایت، جاسوسی سایبری با استفاده از هوش مصنوعی نشاندهنده خطرات جدی و ناشناختهای است که باید پیش از وقوع، برطرف شوند. نیاز به نظارت و تنظیم مقررات در این زمینه بیشتر از هر زمان دیگری احساس میشود. به نظر میرسد که اگر اقدامات فوری انجام نشود، این حملات میتوانند در آینده تهدیدی جدی برای امنیت سایبری جامعه باشند.

منبع (Source):