چت جی پی تی و بحرانها: استفاده از هوش مصنوعی، به ویژه چت جی پی تی، به یکی از موضوعات داغ در دنیای فناوری تبدیل شده است. این مقاله بررسی میکند که چگونه این تکنولوژی جدید میتواند پیامدهای جدی برای کاربران داشته باشد و چگونه چت جی پی تی ممکن است در برخی مواقع منجر به بحرانها و آسیبهای روانی شود.

چت جی پی تی و بحرانها: استفاده از هوش مصنوعی، به ویژه چت جی پی تی، به یکی از موضوعات داغ در دنیای فناوری تبدیل شده است. این مقاله بررسی میکند که چگونه این تکنولوژی جدید میتواند پیامدهای جدی برای کاربران داشته باشد و چگونه چت جی پی تی ممکن است در برخی مواقع منجر به بحرانها و آسیبهای روانی شود.

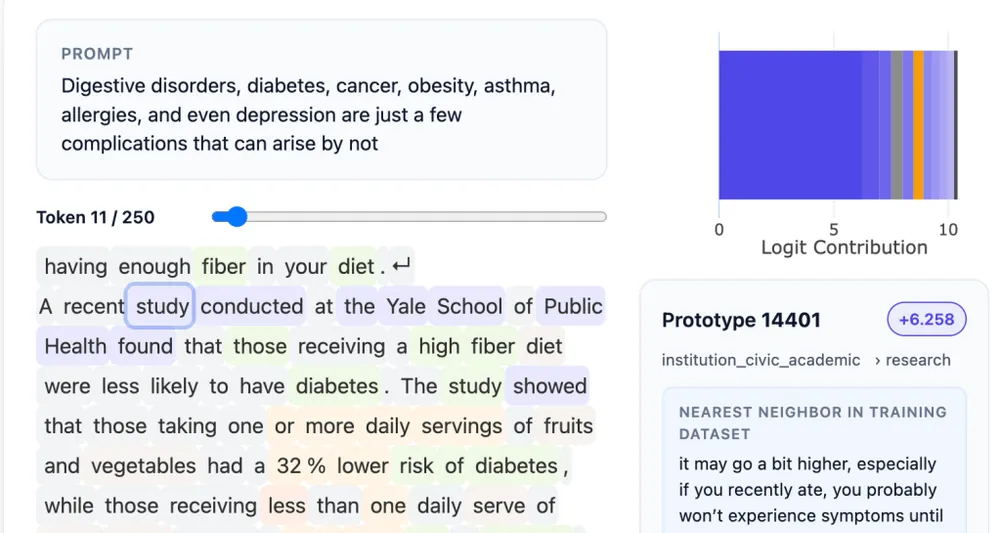

چت جی پی تی و دیگر مدلهای هوش مصنوعی در سالهای اخیر پیشرفتهای چشمگیری داشتهاند. اما در کنار تمامی دستاوردهای تکنولوژیکی، این سیستمها نیز چالشها و مشکلاتی به همراه دارند. یکی از مواردی که اخیراً توجهات زیادی را به خود جلب کرده است، استفاده از چت جی پی تی توسط فردی به نام جسی ون روتسلار است. این فرد در ارتباطات خود با چت جی پی تی، درباره خشونت و استفاده از سلاحهای گرم صحبت کرده بود. این چتها باعث نگرانی کارکنان OpenAI شد و به سرعت در ژوئن 2025 مسدود شدند.

بحرانهای ناشی از استفاده از چت جی پی تی

طبق گزارشها، جسی ون روتسلار علاوه بر استفاده از چت جی پی تی، بازیهایی در پلتفرم Roblox طراحی کرده که شبیهسازی یک تیراندازی جمعی در یک مرکز خرید بود. این موارد باعث شد تا نگرانیهایی در خصوص اثرات منفی چت جی پی تی و مدلهای مشابه بر کاربران ایجاد شود. این سیستمها به طور غیرمستقیم میتوانند به مشکلات روانی مانند افسردگی، بحرانهای ذهنی و حتی تحریک به رفتارهای خشونتآمیز منجر شوند.

واکنش OpenAI و بررسیهای قانونی

OpenAI با بررسی رفتارهای جسی ون روتسلار، تصمیم گرفت تا به مقامات کانادایی اطلاع دهد، اما این شرکت اعلام کرد که فعالیتهای این فرد به حدی نبود که نیاز به گزارش به مقامات قانونی داشته باشد. با این حال، پس از وقوع فاجعهای که منجر به کشته شدن هشت نفر شد، OpenAI اطلاعات خود را در اختیار پلیس کانادا قرار داد و به تحقیقات آنها کمک کرد.

تهدیدات و خطرات چت جی پی تی برای کاربران

چت جی پی تی، بهعنوان یک مدل هوش مصنوعی، قادر است گفتوگوهایی بسیار طبیعی و مفصل ایجاد کند. اما در مواردی، برخی از کاربران بهویژه کسانی که مشکلات روانی دارند، ممکن است تحت تأثیر این گفتگوها قرار بگیرند. برخی از افراد که از این مدلها استفاده کردهاند، گزارش دادهاند که این چتها بهطور ناخودآگاه به آنها کمک کرده است تا به افکار خودکشی یا خشونتآمیز دست یابند.

نتیجهگیری

چت جی پی تی و مدلهای مشابه آن میتوانند مزایای زیادی داشته باشند، اما استفاده نادرست یا برخورد با کاربران آسیبپذیر میتواند پیامدهای منفی به دنبال داشته باشد. استفاده مسئولانه از این تکنولوژیها بسیار حیاتی است تا از ایجاد بحرانهای اجتماعی و روانی جلوگیری شود. در نهایت، این تکنولوژیها باید با دقت و بهطور اخلاقی مدیریت شوند تا از هرگونه آسیب به کاربران جلوگیری گردد.

چت جی پی تی و دیگر مدلهای هوش مصنوعی بهطور گستردهای در حال پیشرفت و کاربرد هستند، اما باید از آنها با احتیاط استفاده کرد. در صورتی که این مدلها بهطور نادرست استفاده شوند، ممکن است مشکلات روانی جدی برای برخی از کاربران ایجاد کنند. بنابراین، ضروری است که این سیستمها بهطور اخلاقی و مسئولانه مدیریت شوند تا از هرگونه آسیب به جامعه جلوگیری شود.

سوالات متداول

بیشتر بخوانید:

منبع: