بحث داغ این روزها درباره هشدارهای هوش مصنوعی تنها یک گفتوگوی علمی نیست؛ بلکه موضوعی است که میتواند آینده شغلها، جامعه و حتی ساختار قدرت جهانی را تحتتأثیر قرار دهد. زمانی که پژوهشگری مطرح میکند که «شرکتهای فناوری باید حافظان بشریت باشند»، اهمیت واکاوی این هشدارهای هوش مصنوعی دوچندان میشود. این مقاله به سراغ همین چشمانداز نگرانکننده میرود و از دل آن تصویری روشنتر برای خواننده میسازد.

سایه سنگین آیندهای که هوش مصنوعی میسازد

بحث درباره هشدارهای هوش مصنوعی از زمانی شدت گرفت که یکی از محققان ارشد DeepSeek در چین پیشبینی کرد موج بزرگی از حذف مشاغل در دو دهه آینده رخ خواهد داد. به گفته او، دوران «ماهعسل» ما با فناوریهای هوشمند بهزودی تمام میشود و جوامع با تغییراتی روبهرو میشوند که شاید از بسیاری بحرانهای تاریخی گستردهتر باشد. او این دگرگونی را به نوعی «طاعون شغلی» تشبیه میکند؛ نه کشنده، اما بهشدت تغییردهنده سبک زندگی.

با این حال، بخش عجیب ماجرا زمانی آغاز میشود که او پیشنهاد میکند مسئولیت مدیریت این بحران باید در اختیار شرکتهای فناوری باشد. این دقیقاً همان نقطهای است که هشدارهای هوش مصنوعی از یک نگرانی منطقی به خطرناکترین گوشه خیالپردازیهای تکنولوژیک کشیده میشود.

چرا سپردن جامعه به دست شرکتهای فناوری اشتباه است؟

این پیشنهاد که غولهای فناوری باید نقش «قیمان بشریت» را ایفا کنند، چیزی از دل رمانهای دیستوپیایی بیرون کشیده شده است. تاریخ بارها نشان داده است که شرکتهایی که تنها بر سود و رشد متمرکزند، گزینه مناسبی برای تصمیمگیری درباره سرنوشت جامعه نیستند. این شرکتها حتی در شرایط عادی هم ثبات اخلاقی ندارند، چه برسد به زمانی که ساختارهای اجتماعی در حال فروپاشی یا تحول سریع باشند.

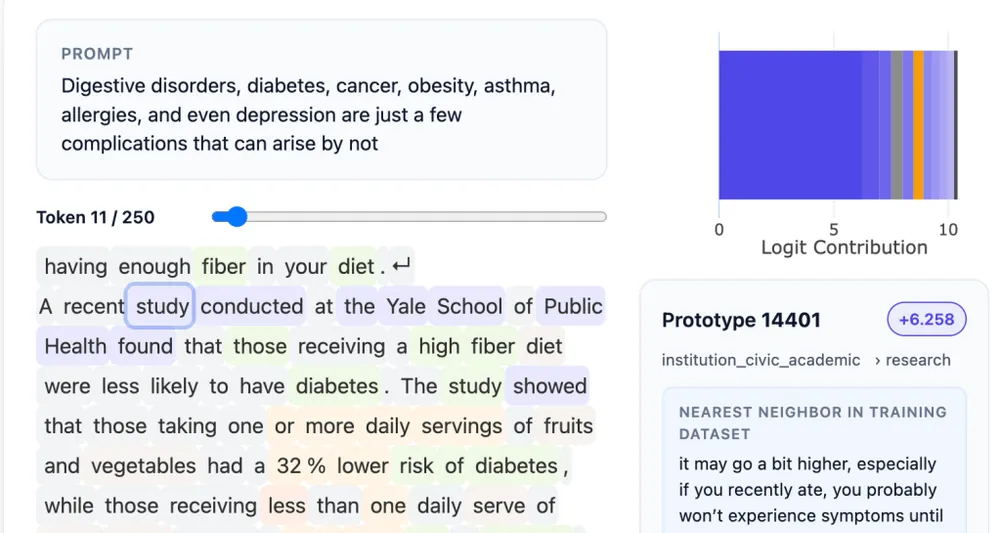

در حال حاضر، همان ابزارهای هوش مصنوعی که قرار است روزی ناجی جامعه باشند، رفتارهای ما را شکل میدهند، سلیقهمان را هدایت میکنند و هر قطعه اطلاعاتمان را به کالایی برای فروش تبدیل میکنند. هشدارهای هوش مصنوعی دقیقاً از اینجا معنا پیدا میکند؛ از این واقعیت که همان نیروهای ناسازگار با منافع عمومی قرار است در نقش نجاتدهنده ظاهر شوند.

نبود انگیزه برای اصلاح

مشکل اصلی این است که اصلاح خطاهای هوش مصنوعی معمولاً برای شرکتها هزینه دارد. یک سیستم استخدام مبتنی بر هوش مصنوعی اگر تبعیضگر باشد، اصلاح آن به معنای صرف منابع است. تولید محتوای بیکیفیت توسط ابزارهای خودکار اگر سودآور باشد، کنار گذاشتن آن به ضرر شرکت است. در چنین شرایطی، چرا باید انتظار رفتار اخلاقی داشت؟ هشدارهای هوش مصنوعی زمانی تبدیل به واقعیتی دردناک میشود که بفهمیم سازندگان این ابزارها در بازی قدرت، نه داورند و نه قهرمان؛ بلکه بازیگران اقتصادیاند.

نیاز به تنظیمگری انسانمحور، نه شرکتمحور

البته دولتها هم چندان روی خوشی در تنظیمگری فناوری نشان ندادهاند. اتحادیه اروپا با قانون AI Act گامی مهم برداشته، اما این قدم هنوز کوچک است. آمریکا درگیر رویکردی واکنشی است و اغلب نمایندگانش هنوز هم معنای دقیق مدلهای زبانی را نمیدانند. چین با وجود سیاستهای سختگیرانه، مدل حاکمیتی دارد که آزادی بیان را محدود و نظارت را عادیسازی میکند. هیچیک از این مسیرها کامل نیست.

این سردرگمی جهانی اما دلیل نمیشود که سکان هدایت را به شرکتهای فناوری بسپاریم. هشدارهای هوش مصنوعی دقیقاً برای همین لحظه است؛ برای زمانی که وسوسه سادهسازی پیچیدگیها ما را به دام اعتماد به بازیگران غیرقابلاعتماد میاندازد. راه واقعی پیش رو، ساخت یک چارچوب چندجانبه است؛ چارچوبی که در آن دولتها، جامعه مدنی، پژوهشگران مستقل و البته برخی از صداهای آگاه در شرکتها کنار هم کار کنند.

فناوری دشمن نیست، اما بدون قاعده میتواند خطرناک شود

برخلاف تصور رایج، نقد هوش مصنوعی به معنای مخالفت با پیشرفت نیست. همانطور که لودیتها بهدنبال نابودی فناوری نبودند، ما نیز بهدنبال توقف پیشرفت نیستیم. مسئله این است که فناوری بدون قواعد درست میتواند به ابزاری برای استثمار و بیثباتی تبدیل شود. هشدارهای هوش مصنوعی از ما میخواهد مراقب باشیم چه کسانی را پشت فرمان آینده مینشانیم.

راهحل نهایی شاید هنوز کامل نباشد، اما قطعات آن در دسترساند: سیاستگذاری اصولمحور، ائتلافهای چندملیتی، و فشار عمومی برای حفظ کرامت انسان در عصر الگوریتمها. آیندهای انسانیتر زمانی ممکن میشود که قوانین محکمتر از وعدههای شرکتی باشند.

هشدارهای هوش مصنوعی درباره آینده با سرعتی فراتر از حد انتظار به واقعیت نزدیک میشود، اما انتخاب اینکه چه کسانی هدایت این مسیر را بر عهده بگیرند بر آینده جامعه اثر میگذارد. اعتماد بیچونوچرا به شرکتهای فناوری خطرناک است، اما ساخت سازوکاری انسانی، علمی و چندجانبه میتواند مسیر را ایمنتر کند. آینده ما نه در دست الگوریتمها، بلکه در واکنش آگاهانهمان به همین هشدارهای هوش مصنوعی رقم میخورد.

پرسشهای متداول

بله، بسیاری از کارشناسان تأیید میکنند که هشدارهای هوش مصنوعی درباره حذف گسترده مشاغل جدی است، اما سرعت و گستره آن به سیاستگذاری و مدیریت درست این فناوری بستگی دارد.

با توجه به هشدارهای هوش مصنوعی و سوابق شرکتها در اولویت دادن به سود، سپردن نقش تنظیمگری به آنها نهتنها منطقی نیست، بلکه میتواند خطرناک باشد.

براساس تحلیلهای مرتبط با هشدارهای هوش مصنوعی، بهترین مدل نظارت ترکیبی از دولتها، پژوهشگران مستقل و نهادهای مدنی است تا منافع عمومی قربانی سود شرکتها نشود.

منبع (Source):