یکی از چالشهای اصلی در استفاده از مدلهای هوش مصنوعی، درک عملکرد آنها و چرایی انجام دادن کارها است. مدلهای قابل تفسیر هوش مصنوعی، مانند Steerling-8B از Guide Labs، به حل این مشکل کمک میکنند و امکان پیگیری و تفسیر هر توکن تولید شده توسط مدل را فراهم میآورند. این نوآوریها چه تاثیری در دنیای هوش مصنوعی خواهند داشت؟

یکی از چالشهای اصلی در استفاده از مدلهای هوش مصنوعی، درک عملکرد آنها و چرایی انجام دادن کارها است. مدلهای قابل تفسیر هوش مصنوعی، مانند Steerling-8B از Guide Labs، به حل این مشکل کمک میکنند و امکان پیگیری و تفسیر هر توکن تولید شده توسط مدل را فراهم میآورند. این نوآوریها چه تاثیری در دنیای هوش مصنوعی خواهند داشت؟

چالشهای درک عملکرد مدلهای هوش مصنوعی

در بسیاری از مواقع، یکی از اصلیترین مشکلات در زمینه مدلهای هوش مصنوعی، فهم چرایی و چگونگی عملکرد آنها است. مدلهایی مانند Grok از xAI و ChatGPT از OpenAI ممکن است در برخی مواقع با مشکلاتی مانند هذیانگویی یا تناقضهای منطقی روبهرو شوند. بنابراین، ایجاد مدلهای هوش مصنوعی قابل تفسیر میتواند قدم مهمی در بهبود استفاده از این فناوری باشد.

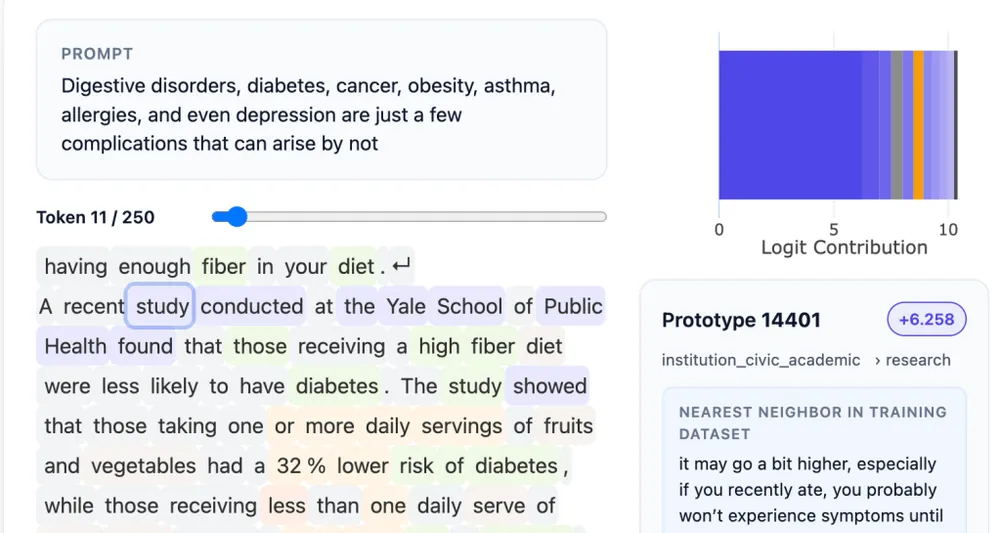

Guide Labs، یک استارتاپ از سانفرانسیسکو، به تازگی مدل جدید خود به نام Steerling-8B را معرفی کرده که میتواند عملکرد خود را بهطور کامل تفسیر کند. این مدل با 8 میلیارد پارامتر طراحی شده و توانایی پیگیری هر توکنی که تولید میکند را دارد، به این معنی که میتوان منبع دادههای آموزشی هر کدام از توکنها را شناسایی کرد.

این رویکرد جدید به توسعهدهندگان کمک میکند تا منابع اطلاعاتی مدل را درک کنند، چه در زمینه اطلاعات علمی باشد و چه در موضوعاتی مانند طنز و جنسیت. گرستنهابر، یکی از مدیران Guide Labs، به TechCrunch گفته است که اگر یک مدل دادههای مختلفی را برای رمزگذاری مفهوم جنسیت استفاده کند، لازم است تمام این دادهها بهطور دقیق شناسایی و کنترل شوند.

مدلهای قابل تفسیر و راهحلهای جدید برای صنایع

این مدلهای قابل تفسیر، کاربردهای گستردهای در صنایع مختلف دارند. به عنوان مثال، در صنایع مصرفی و خدماتی، مانند پلتفرمهایی که از مدلهای هوش مصنوعی برای ارائه خدمات به مشتریان استفاده میکنند، این امکان وجود دارد که محتوای نادرست یا مضر فیلتر شود. در زمینههای نظارتی، مانند صنعت مالی، این مدلها میتوانند در ارزیابی درخواستهای وام بهطور منصفانهتر عمل کنند، بدون اینکه به عواملی مانند نژاد توجه کنند.

در زمینه علم نیز، استفاده از این مدلها میتواند تحولی بزرگ ایجاد کند. در حالی که مدلهای هوش مصنوعی موفقیتهای بزرگی در زمینههایی مانند تأثیرگذاری پروتئینها داشتهاند، این مدلها نیاز به شفافیت بیشتری در زمینه دلیلیا نتایج آنها دارند. مدلهای قابل تفسیر به دانشمندان این امکان را میدهند که بفهمند چرا یک ترکیب خاص از پروتئینها انتخاب شده است و چگونه این ترکیبها به یافتههای علمی جدید منجر میشوند.

ویژگیهای Steerling-8B: مدل جدید Guide Labs

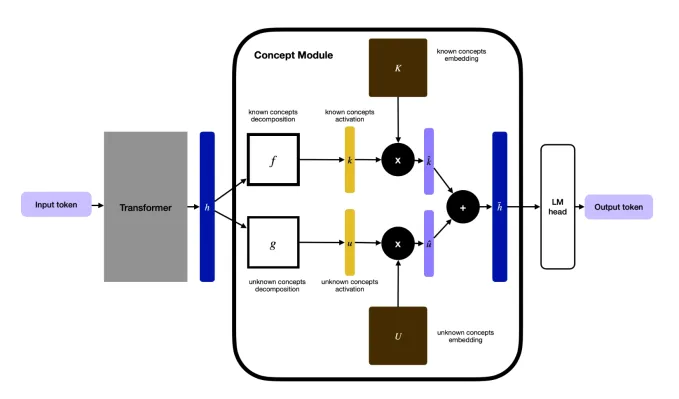

Steerling-8B یکی از بزرگترین دستاوردهای Guide Labs است. این مدل جدید، با بهرهگیری از معماری خاص خود، قادر است 90 درصد از قابلیتهای مدلهای موجود را در حالی که از دادههای آموزشی کمتری استفاده میکند، ارائه دهد. این مدل از لایه مفهومی برای دستهبندی دادهها استفاده میکند که باعث میشود فرآیند تفسیر عملکرد مدل بسیار سادهتر و قابل پیگیری باشد.

این ویژگیها باعث میشود که Steerling-8B هم در سطح توانمندی مشابه مدلهای پیشرفته قرار بگیرد و هم از دادههای کمتری برای آموزش بهرهبرداری کند. این نوآوری میتواند تغییرات زیادی در نحوه ساخت و استفاده از مدلهای هوش مصنوعی در آینده ایجاد کند.

مدلهای هوش مصنوعی قابل تفسیر و آینده صنعت

Guide Labs معتقد است که آینده مدلهای هوش مصنوعی به سمت استفاده از مدلهای قابل تفسیر خواهد رفت. این مدلها نه تنها در صنعت مصرفی، بلکه در بخشهای نظارتی و علمی نیز بهطور گستردهای استفاده خواهند شد. به گفته گرستنهابر، توسعه این مدلها به گسترش دسترسی به هوش مصنوعی و اطمینان از استفاده درست از آن کمک خواهد کرد.

این مدلها میتوانند به کاهش مشکلات اخلاقی و امنیتی که در حال حاضر مدلهای هوش مصنوعی با آن روبهرو هستند کمک کنند. در آینده، اگر مدلهای هوش مصنوعی بتوانند بهطور کامل تفسیر شوند، میتوان از آنها در محیطهایی مانند بانکداری، مراقبتهای بهداشتی و حتی سیاستگذاری استفاده کرد.

نتیجهگیری: تغییرات بنیادی در مدلهای هوش مصنوعی

مدلهای قابل تفسیر هوش مصنوعی مانند Steerling-8B نشاندهنده یک تحول بزرگ در نحوه طراحی و استفاده از مدلها هستند. این مدلها نه تنها امکان درک و تفسیر دقیقتر عملکرد مدلها را فراهم میآورند، بلکه بهطور قابل توجهی از ریسکهای اخلاقی و امنیتی میکاهند. آینده این فناوری بهطور قطع به سمت ایجاد مدلهایی با قابلیتهای تفسیرپذیر خواهد رفت که میتواند به بهبود استفاده از هوش مصنوعی در صنایع مختلف منجر شود.

مدلهای قابل تفسیر هوش مصنوعی، مانند Steerling-8B، گام بزرگی در راستای درک بهتر و استفاده امنتر از مدلها هستند. این نوآوریها میتوانند به حل چالشهای موجود در هوش مصنوعی کمک کرده و آیندهای شفافتر و مسئولانهتر برای این فناوری به ارمغان آورند.

سوالات متداول

بیشتر بخوانید:

منبع: