مطالعهای تازه نشان داده که خطاهای دستیارهای هوش مصنوعی در اخبار به سطحی نگرانکننده رسیده است. از ChatGPT گرفته تا Google Gemini، این ابزارها در پاسخ به پرسشهای خبری کاربران اغلب دچار اشتباههای فاحش میشوند. در دنیایی که هوش مصنوعی به منبع اصلی دریافت اطلاعات بدل شده، این یافتهها زنگ خطری جدی برای اعتبار اخبار محسوب میشوند.

نیمی از پاسخهای خبری هوش مصنوعی نادرست یا ناقص هستند

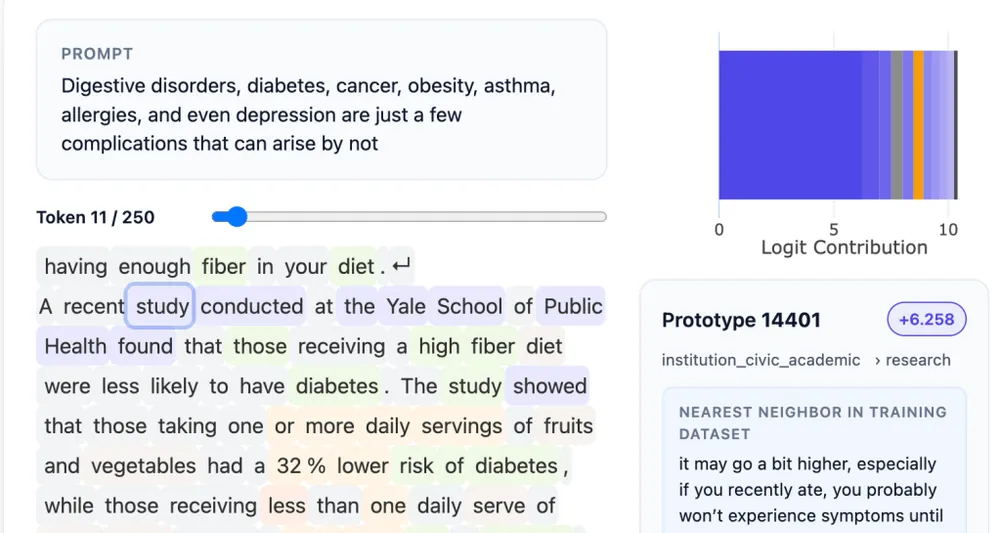

بر اساس گزارش گستردهای که توسط BBC و اتحادیه پخش اروپا (EBU) انجام شد، تقریباً ۴۵٪ از پاسخهای خبری ارائهشده توسط دستیارهای هوش مصنوعی دارای مشکلات اساسی بودند. این پژوهش که در ۱۸ کشور و ۱۴ زبان مختلف اجرا شد، بیش از ۳۰۰۰ پاسخ از ChatGPT، مایکروسافت Copilot، گوگل Gemini و Perplexity را مورد بررسی قرار داد.

روزنامهنگاران حرفهای از ۲۲ رسانه عمومی هر پاسخ را از نظر دقت، منبع و تشخیص میان خبر و نظر تحلیل کردند. نتایج نشان داد که حدود ۳۱٪ از پاسخها مشکل منبع داشتند و ۲۰٪ کاملاً نادرست بودند. به عبارت دیگر، تقریباً نیمی از پاسخها بهنوعی غیرقابل اعتماد بودند.

Gemini؛ بدترین عملکرد میان رقبا

در حالی که هر چهار دستیار مورد بررسی خطاهایی داشتند، گوگل Gemini بیشترین میزان اشتباه را ثبت کرد. طبق گزارش، این ابزار در ۷۶٪ از پاسخها دچار خطا یا کمبود منبع بود. بر خلاف جستجوی سنتی گوگل که به کاربر امکان بررسی چندین منبع را میدهد، پاسخهای چتباتها مانند Gemini یا ChatGPT معمولاً بهصورت قطعی و نهایی ارائه میشوند. همین ویژگی باعث میشود کاربران گمان کنند که اطلاعات ارائهشده دقیق و بررسیشدهاند، در حالی که اغلب چنین نیست.

در بسیاری از زبانها، این دستیارها جزئیات خیالی تولید کردند یا نقلقولهایی را به رسانههایی نسبت دادند که هرگز چنین مطالبی منتشر نکرده بودند. در برخی موارد نیز، نبود زمینه کافی باعث شد معنای کل خبر تغییر کند و کاربر برداشت اشتباهی از واقعیت پیدا کند. این نوع خطاها نشان میدهد که خطاهای دستیارهای هوش مصنوعی در اخبار تنها تصادفی نیستند، بلکه ساختاری و سیستماتیکاند.

رشد استفاده از هوش مصنوعی برای دریافت اخبار

گزارش مؤسسه Reuters در سال ۲۰۲۵ نشان میدهد که حدود ۷٪ از مصرفکنندگان آنلاین خبر، از دستیارهای هوش مصنوعی برای دریافت اطلاعات استفاده میکنند. این رقم در میان کاربران زیر ۲۵ سال به ۱۵٪ میرسد. این بدان معناست که میلیونها نفر در سراسر جهان در حال دریافت اخبار از سیستمی هستند که هنوز در درک واقعیت و دقت در منابع دچار ضعف جدی است.

ChatGPT و سایر مدلهای مشابه، اغلب در تشخیص مرز میان واقعیت و تحلیل یا نظر دچار خطا میشوند. نکته خطرناکتر این است که اشتباههای آنها چنان با اطمینان بیان میشود که کاربران حتی متوجه خطا نمیشوند. همین مسئله سبب شده تا نیاز به سواد رسانهای دیجیتال و آموزش تشخیص اطلاعات درست از غلط بیش از پیش احساس شود.

راهکارها برای مقابله با گسترش اطلاعات نادرست

برای مقابله با این چالش، اتحادیه EBU مجموعهای به نام “News Integrity in AI Assistants Toolkit” منتشر کرده است. این جعبهابزار، مجموعهای از دستورالعملها برای توسعهدهندگان و روزنامهنگاران است تا بتوانند کیفیت پاسخهای مبتنی بر هوش مصنوعی را ارزیابی و بهبود دهند. در این راهنما، معیارهایی برای پاسخهای دقیق و نشانههای هشداردهنده برای خطاهای احتمالی ذکر شده است.

با وجود پیشرفتهای سریع شرکتهایی مانند OpenAI و Google در توسعه نسخههای جدیدتر و هوشمندتر از دستیارهایشان، هنوز شفافیت و مسئولیتپذیری از مهمترین نیازهای این حوزه به شمار میرود. هوش مصنوعی میتواند ابزاری قدرتمند برای گردآوری و خلاصهسازی اخبار باشد، اما تا زمانی که خطاهای دستیارهای هوش مصنوعی در اخبار برطرف نشود، کاربران باید با احتیاط از آن استفاده کنند و همیشه به منابع معتبر مراجعه نمایند.

نتایج این پژوهش نشان میدهد که هرچند هوش مصنوعی میتواند ابزار مفیدی برای دسترسی سریع به اطلاعات باشد، اما خطاهای دستیارهای هوش مصنوعی در اخبار نباید نادیده گرفته شوند. تا زمانی که این سیستمها به سطح بالایی از دقت و شفافیت نرسیدهاند، بهترین راه برای کاربران، بررسی منابع اصلی و حفظ سواد رسانهای دیجیتال است.

پرسشهای متداول

زیرا این مدلها اطلاعات خود را از دادههای پراکنده و گاهی نامعتبر جمعآوری میکنند و توانایی تشخیص کامل میان خبر و تحلیل را ندارند.

در حال حاضر خیر. طبق گزارش BBC، خطاهای دستیارهای هوش مصنوعی در اخبار زیاد است و پاسخهای ChatGPT نیز گاهی ناقص یا نادرستاند.

بهترین روش، مقایسه پاسخها با منابع رسمی و معتبر مانند وبسایتهای خبری شناختهشده و بررسی منبع نقلقولها است.

منبع (Source):