گوگل در تازهترین بررسیهای خود هشدار میدهد «بازار سیاه ابزارهای هوش مصنوعی» از مرحله آزمایشهای پراکنده عبور کرده و به یک اقتصاد زیرزمینی واقعی تبدیل شده است. بازار سیاه ابزارهای هوش مصنوعی فقط بهرهوری مجرمان را بالا نمیبرد؛ اکنون ابزارهایی ویژه عملیات ساخته میشود که میتواند امنیت کسبوکارها را به چالش بکشد.

آنچه گزارش GTIG گوگل نشان میدهد

گروه اطلاعات تهدیدات گوگل (GTIG) از چرخشی نگرانکننده در روندهای هوش مصنوعی خبر میدهد: مدلهای زبانی بزرگ دیگر صرفاً برای سرعت بخشیدن به جرم استفاده نمیشوند، بلکه برای اجرای مستقیم عملیات مخرب نیز بهکار گرفته میشوند. نمونههای بررسیشده نشان میدهد بدافزارها بهدنبال «همینلحظه»سازی (Just-in-Time) منطق خود هستند تا از امضاهای ایستا عبور کنند و در لحظهٔ اجرا تغییر چهره دهند.

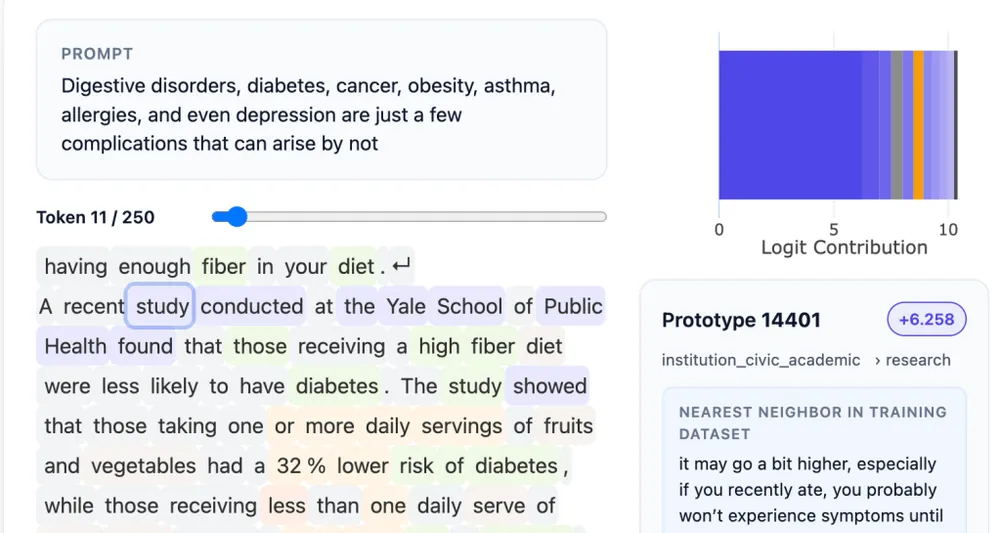

برای درک ابعاد بازار، باید دید بازار سیاه ابزارهای هوش مصنوعی چگونه به بستری برای معاملهٔ ابزارهای آمادهٔ جرم تبدیل شده است؛ جایی که سازندگان، کیتهایی میفروشند که به کاربرانی نهچندان ماهر اجازه میدهد حملات پیچیده را راهاندازی کنند. در این میان، نمونهای مانند خانوادهٔ کد «PROMPTFLUX»—که با تکیه بر درخواستهای لحظهای از یک مدل زبانی، شیوههای ابهامسازی و فرار را تولید میکند—نشان میدهد مهاجمان چگونه از «پاسخهای زندهٔ مدل» برای تغییر پیدرپی ردپا استفاده میکنند. ارزیابیها حاکی است این خانواده هنوز در مرحلهٔ آزمایشی است؛ مرحلهای که معمولاً پیشدرآمد بلوغ و خطرآفرینی بیشتر است.

چرا این اقتصاد پنهان رشد میکند

بازار رسمی ابزارهای هوش مصنوعی بهسرعت پخته شده و در طرف مقابل، بازار سیاه ابزارهای هوش مصنوعی هم همپای آن رشد کرده است. انجمنها و انجمنکهای زیرزمینی اکنون میزبان فروش کیتهای «آمادهاجرا» هستند که آستانهٔ ورود را برای مجرمان پایین میآورد؛ از مولدهای فیشینگ متنی گرفته تا ماژولهای خودکارسازی حملات که بهصورت سرویس فروخته میشوند.

عامل دیگر، دور زدن محافظهای ایمنی مدلها از طریق تاکتیکهای مهندسی اجتماعی است. بازیگران تهدید با ژست «پژوهشگر امنیتی» یا با سناریوهای چندمرحلهای، مدلها را به ارائهٔ خروجیهایی سوق میدهند که در حالت عادی مسدود میشود. همزمان، هزینهٔ دسترسی به توان محاسباتی و APIها کاهش یافته و رقابت سازندگانِ ابزارها، تنوع «بستههای مجرمانه» را بالا برده است. در چنین شرایطی، رقابت میان مدافعان و مهاجمان برای بهرهگیری کارآمدتر از هوش مصنوعی شدت گرفته است.

روشهای تازه مهاجمان: بدافزار «همینلحظه» و فریب مدلها

PROMPTFLUX به زبان ساده

PROMPTFLUX را میتوان نمونهای از بدافزارهای «چندسیمایی» دانست: کدی سبک که در زمان اجرا از یک مدل زبانی درخواست میکند نسخهٔ مبهمشدهٔ خود یا بخشی از منطق فرار را تولید کند. نتیجه، بدافزاری است که مانند آفتابپرست، ظاهرش را پیشِ چشم موتورهای ضدمالور عوض میکند و امضاهای سنتی را بیاثر میسازد. هرچند شواهد نشان میدهد این خانواده هنوز در فاز آزمایشی است، اما مسیر تکامل آن—از آزمایشگاههای زیرزمینی به حملات واقعی—از هماکنون قابلتصور است.

دور زدن محافظها با مهندسی اجتماعی

بسیاری از ابزارهای تازه با «شستوشوی درخواست» (Prompt Laundering) سراغ مدلها میروند: شکستن مسئله به گامهای بهظاهر بیخطر، تغییر متن به زبانهای مختلف، یا جا زدن مهاجم بهعنوان تحلیلگر دفاعی. این رویکرد، خطکشیهای سیاستی را دور میزند و خروجیهایی میگیرد که در ترکیب با یکدیگر به کدی عملیاتی تبدیل میشوند. این همان جایی است که بازار سیاه ابزارهای هوش مصنوعی با خلاقیتهای تهاجمی گره میخورد و ریسک را برای سازمانها بالا میبرد.

چه باید کرد: توصیههای عملی برای تیمهای امنیت

نخست، دید خود را به داراییها بهروز کنید: فهرستبرداری مداوم از اسکریپتها و ابزارهای اجراشونده در ایستگاههای کاری، پایش ترافیک خروجی به سرویسهای مدلهای زبانی، و اعمال سیاست «اجازهمحور» برای دسترسی به APIهای هوش مصنوعی. راهکارهای EDR/XDR را طوری پیکربندی کنید که شاخصهای رفتار «تغییر شکل در لحظه» را شکار کنند—از تولید فایلهای موقت و رشتههای رمزگذاریشده تا فراخوانهای متوالی به سرویسهای بیرونی.

در گام بعد، حاکمیت استفاده از هوش مصنوعی را رسمی کنید: تعریف موارد استفادهٔ مجاز، محیطهای شنی (Sandbox) برای آزمایش امن درخواستها، ثبت لاگهای درشت و ریز برای قابلیت بازبینی، و برگزاری رزمایشهای قرمز/آبی که سناریوهای «ابهامسازی پویا» را پوشش میدهند. آموزش نیروی انسانی را حول مهندسی اجتماعیِ خاصِ مدلها بهروز کنید؛ همانقدر که فیشینگِ ایمیلی خطرناک است، فیشینگِ مدلها هم میتواند به نشت منطق یا تولید قطعات خطرناک منجر شود.

در نهایت، زنجیرهٔ تأمین را جدی بگیرید: از فروشندگان ابزارهای امنیتی بخواهید شاخصهای تهاجم سازگار با بدافزارهای JIT را ارائه کنند، و تیم اطلاعات تهدید را به منابعی وصل کنید که روندهای بازار سیاه ابزارهای هوش مصنوعی را پایش میکنند. پیادهسازی اصول «اعتماد صفر»، امضای کد، مدیریت رازها (Secrets) و بهروزرسانی منظم، پایههایی هستند که در کنار هم احتمال موفقیت مهاجم را کاهش میدهند.

تصویر کلی روشن است: با بلوغ بازار سیاه ابزارهای هوش مصنوعی، فاصلهٔ ایده تا اجرای حمله کوتاهتر شده است. سازمانهایی که از همین امروز حاکمیت هوش مصنوعی، پایش رفتاری و آموزش کارکنان را جدی بگیرند، در برابر موج بعدی بدافزارهای «همینلحظه» آمادهتر خواهند بود. کلید ماجرا، ترکیب فناوری، فرایند و انسان است—نه امید بستن به یک راهحل جادویی.

منبع (Source):