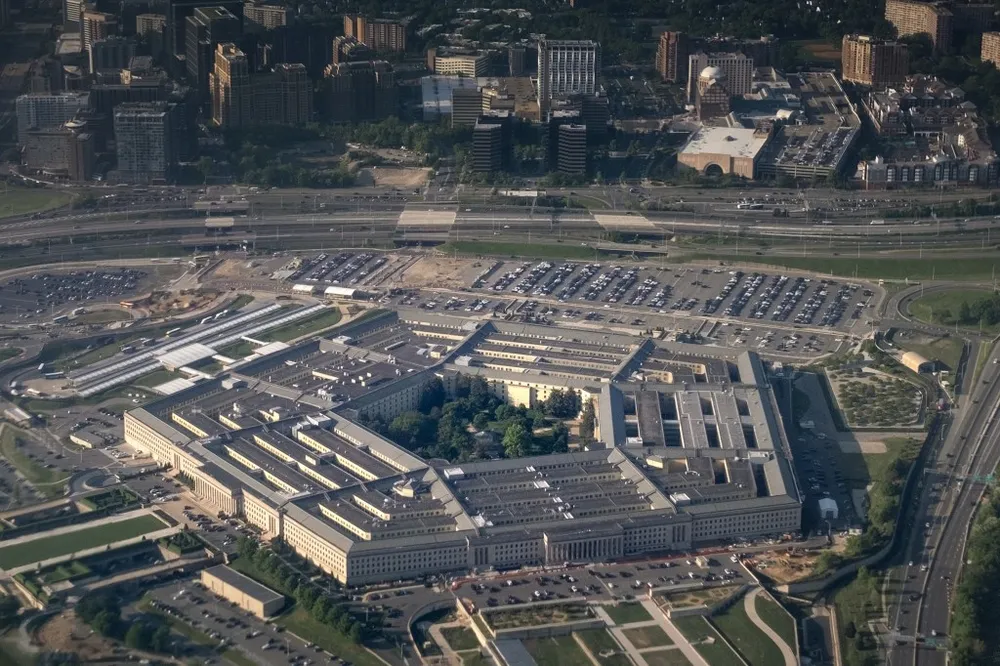

استفاده از مدلهای هوش مصنوعی در عملیاتهای نظامی بحثهای زیادی را به همراه داشته است. در این میان، مدل کلود آنتروپیک که توسط شرکت آنتروپیک توسعه داده شده، در کانون توجه قرار گرفته است. این مقاله به بررسی کشمکشها و چالشهای پیش روی پنتاگون و آنتروپیک در زمینه استفاده از مدل کلود در عملیاتهای نظامی میپردازد.

استفاده از مدلهای هوش مصنوعی در عملیاتهای نظامی بحثهای زیادی را به همراه داشته است. در این میان، مدل کلود آنتروپیک که توسط شرکت آنتروپیک توسعه داده شده، در کانون توجه قرار گرفته است. این مقاله به بررسی کشمکشها و چالشهای پیش روی پنتاگون و آنتروپیک در زمینه استفاده از مدل کلود در عملیاتهای نظامی میپردازد.

کشمکشهای میان آنتروپیک و پنتاگون

پنتاگون اخیراً فشار زیادی به شرکتهای هوش مصنوعی وارد کرده تا اجازه دهند که این فناوریها در عملیاتهای نظامی با اهداف «تماماً قانونی» مورد استفاده قرار گیرند. در این میان، شرکت آنتروپیک که مسئول توسعه مدل کلود است، به شدت با این خواستههای پنتاگون مخالفت کرده است. طبق گزارشها، دولت آمریکا از شرکتهای مختلف مانند OpenAI، گوگل و xAI نیز خواسته است که در این زمینه همکاری کنند.

واکنش آنتروپیک به درخواست پنتاگون

آنتروپیک به طور خاص در مقابل خواستههای پنتاگون مقاومت نشان داده است و در پاسخ به فشارهای موجود، اعلام کرده که تمرکز اصلی آن بر سیاستهای استفاده از مدلهای خود است و نه بهکارگیری آنها در عملیاتهای خاص نظامی. این شرکت تأکید کرده که هیچگونه توافقی در خصوص استفاده از مدل کلود در عملیاتهای نظامی با وزارت دفاع ایالات متحده نداشته است. یکی از مقامات سابق دولت ترامپ نیز گفته است که یکی از این شرکتها با این درخواست موافقت کرده و دو شرکت دیگر با شرایطی خاص حاضر به انعطاف شدهاند.

تهدید پنتاگون برای قطع قرارداد با آنتروپیک

در حالی که آنتروپیک با درخواستهای پنتاگون مخالفت میکند، این نهاد تهدید کرده است که قرارداد ۲۰۰ میلیون دلاری خود با آنتروپیک را لغو خواهد کرد. این موضوع باعث ایجاد یک بحران جدی میان این دو طرف شده است و آینده همکاریها در این زمینه را به شدت تحت تأثیر قرار داده است.

کاربرد مدل کلود در عملیاتهای نظامی

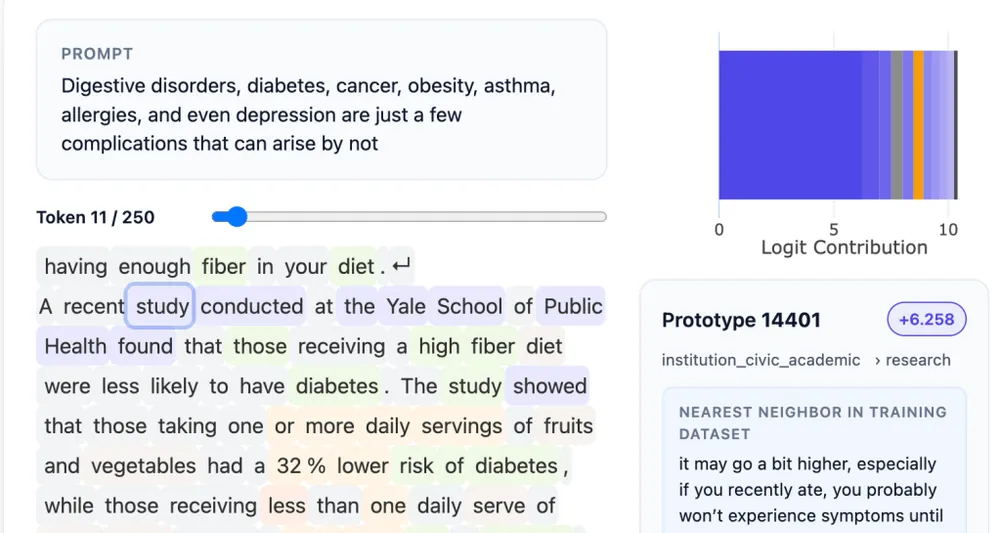

مدل کلود آنتروپیک بهطور مشخص در عملیاتهای مختلف نظامی مورد استفاده قرار گرفته است. طبق گزارشهای منتشر شده، این مدل در عملیات نظامی ایالات متحده برای دستگیری نیکولاس مادورو، رئیسجمهور وقت ونزوئلا، بهکار گرفته شد. این استفاده از مدلهای هوش مصنوعی برای اهداف نظامی، پرسشهای زیادی را در خصوص مسائل اخلاقی و قانونی آن ایجاد کرده است.

چالشها و محدودیتهای استفاده از هوش مصنوعی در ارتش

آنتروپیک بهطور واضح محدودیتهایی برای استفاده از مدلهای هوش مصنوعی خود تعیین کرده است. این شرکت بهویژه بر روی مسائل مربوط به سلاحهای کاملاً خودمختار و نظارت جمعی داخلی تأکید کرده و اعلام کرده که در این زمینهها محدودیتهای سختگیرانهای دارد. این محدودیتها بهویژه زمانی مطرح میشوند که صحبت از استفاده از این مدلها در عملیاتهای نظامی و نظارتهای گسترده داخلی میشود.

نتیجهگیری

در مجموع، استفاده از مدل کلود آنتروپیک در پنتاگون نشاندهنده یکی از چالشهای عمده در راستای هماهنگی بین شرکتهای هوش مصنوعی و نهادهای دولتی است. این کشمکشها نهتنها بر آینده همکاریها تأثیر خواهد گذاشت، بلکه میتواند در آینده به عنوان یک مدل برای نحوه تعامل بین فناوریهای پیشرفته و مسائل امنیتی و قانونی مطرح شود.

استفاده از مدلهای هوش مصنوعی مانند کلود در عملیاتهای نظامی همچنان با چالشهای قانونی و اخلاقی مواجه است. مخالفت آنتروپیک با استفاده از این مدلها در چنین زمینههایی نشاندهنده نگرانیهای جدی در خصوص محدودیتها و نظارتهای این فناوریها است. این موضوع احتمالاً در آینده بهعنوان یکی از مهمترین مسائل در حوزه هوش مصنوعی و امنیت ملی مطرح خواهد شد.

سوالات متداول

منبع: